內容摘要

文章以一份創業者使用大模型生成的商業計劃書為引子,討論了"大模型的幻覺與人類的理性,哪個更值得信賴"。大模型展現出冷靜、穩定、快速的"計算性理性",但其概率驅動、數據污染、解碼策略與不確定性失配導致幻覺頻發。雖然已有一些最新方法顯著降低幻覺,但仍難以根治。相對地,人類在古希臘哲學傳統中被視為"理性的動物",但現實中更多受生命意志、本能與敍事影響。行為經濟學揭示人類常陷入樂觀偏差與損失規避,敍事經濟學則説明故事傳播能主導經濟行為。人類的"去幻"依賴流程與制度設計,如預歿檢討、紅隊反駁、基準率優先、概率校準、冷靜期等。文章最後比較兩類理性並指出,在數據完備、規則明確的場景中應優先信賴大模型,在價值密集、情境複雜的場景中應優先信賴人類。最值得依賴的是"混合理性":將大模型用於事實校驗和快速推理,把人類用於價值判斷和情境取捨,在同一決策鏈條中結合,才能構建更可靠的理性。

全文

前幾天我收到一份企業級AI工具的BP,需要用一串亮眼數字來提升投資人對市場的期待。我們在咖啡館對稿,他打開電腦給我看剛出爐的市場分析:邏輯緊湊、數據堆得很滿、排版也專業,看上去足以打動任何審閲者。

我掃到封面那行核心數字:"2025年中國企業級AI市場規模預計突破3000億"。這數字很誘人,但我還是問:"是哪家機構出的?"他笑笑,有點尷尬:"DeepSeek給的,還有鏈接。"點開一看,是個空鏈接。

其實無論是ChatGPT、DeepSeek還是Gemini,都會出現"幻覺(hallucination)"。

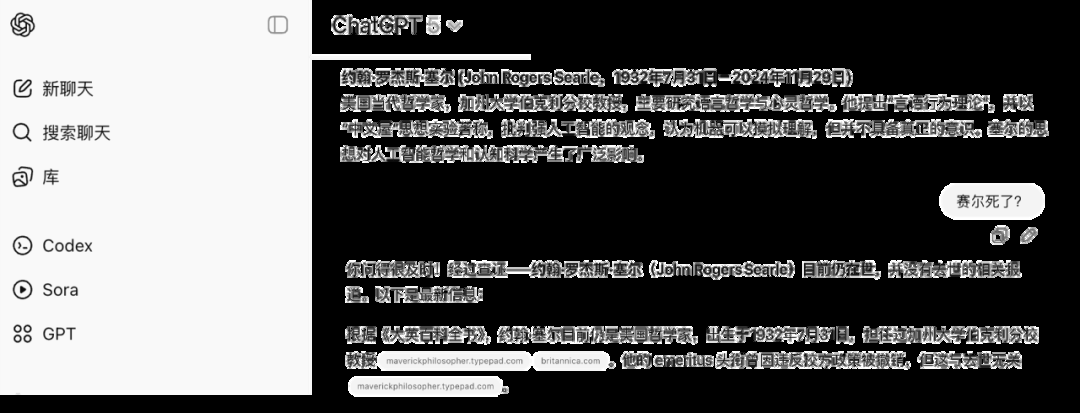

比如我前幾天寫稿,ChatGPT居然聲稱"提出中文屋思想實驗的約翰·塞爾逝於2024年11月29日"。要不是又去Wikipedia核對,真要鬧笑話。面對不確定事實,模型會用概率和語言模式去補全一個看似自洽的答案.它並非故意撒謊,只是在延續語境的合理性。

人類也不見得更好。創業和決策中,我們同樣會被認知偏差和故事帶偏。2013年諾貝爾經濟學獎獲得者羅伯特·席勒的敍事經濟學指出,很多經濟行為受"動人敍事"驅動;泡沫、恐慌和投資潮往往由一個看似有説服力的故事放大。而行為經濟學進一步揭示樂觀偏差、損失規避、過度自信等系統性錯誤。這些錯誤有時比模型的幻覺更難消除,因為它們不僅來自信息缺口,更深植於情緒與身份認同。

大模型的理性:冷靜與幻覺並存

表面上,大模型像冷靜的理性化身:不疲倦、不帶情緒,能在秒級整合海量資料並保持邏輯一致,所以在許多任務上表現出超強的一致性與條理性。但"理性"不等於"真實"。

語言模型仍會生成看似合理卻不真實的內容(幻覺/編造),甚至在自信度很高時也會發生,以權威口吻輸出錯誤;這在近年的綜述與實證研究中反覆被證實[1]。

幻覺的成因並非單一。其一,模型的基本目標是"下一個詞的條件概率預測",當外部事實缺位或檢索不足時,它傾向以高流暢度"補全"最可能的敍述,而不是停下來求證;這讓分佈外問題更易被"貌似合理"的文本替代。其二,訓練語料的噪聲、過時或污染數據會把偏誤固化進參數。其三,缺乏與外部世界的強約束(grounding)與不當解碼策略,會把小偏差放大為長文本中的系統性錯誤。其四,不確定性"校準"不足:即使"知道"正確答案,也可能在高置信度下給出錯誤結論。多篇研究表明,幻覺與訓練目標、數據質量、分佈遷移、解碼策略和不確定性失配共同相關,而非某個環節的偶發問題[2]。

因此,大家圍繞"如何降幻覺"做了大量工程與學術嘗試,但目前總體是"顯著緩解而非根治"。一類思路是在生成前後補"求證環":檢索增強生成(RAG)把外部知識接入流程以減少"無根文本"[3];鏈式驗證(CoVe)讓模型先寫草稿、再自擬核查問題並獨立作答,最後據驗證結果改寫[4]。另一類直接在推理/解碼期動手術:如分層對比解碼ActLCD、跨層一致性解碼DCLA等,在不改動參數的前提下抑制解碼期的錯誤擴散[5];還有利用"層級語義片段"(HSP)進行一致性比對的方案,既能識別和回收幻覺,又報告了更低算力消耗[6]。同時,以"語義熵"為代表的不確定性檢測用來"只在可疑時觸發昂貴校驗",把計算集中到高風險片段[7]。這些路徑在多項基準上顯著降幻覺,但業界共識仍是:想"完全消除"很難,因為問題根植於生成式模型的概率本性與開放世界的邊界。

人類的理性:傳統的燈塔與本性的暗流

古希臘的哲學家們給了個清晰的起點。柏拉圖把靈魂分為理性λόγος、情緒θυμός與慾望έρως。亞里士多德直接定義人是"理性的動物",並強調實踐智慧,在具體情境中做對的事。斯多葛把共識(συγκατάθεση)視為理性靈魂的機能,對印象(φαντασία)給出或保留判斷,由此才產生"衝動/行動"。這一傳統把"能論證,能自我約束"當成人類的核心能力。

但人類並非總是依理性行事。尼采強調,驅動行動的是生命意志:創造、擴張、爭勝,這些內在衝動在創業環境中尤其強烈。行為經濟學進一步將人類非理性拆解為:系統1(快速但易誤判)和系統2(可靠但消耗大),而我們常常惰於啓動後者。前景理論表明,人類對損失過度敏感、對概率反應不夠理性。敍事經濟學則指出好故事通過社交網絡與媒體迅速傳播,直接影響消費、投資與政策預期,股票市場價格也圍着故事跳舞。很多時候,我們的判斷實則被敍事牽引。結論顯而易見:人類自視為理性動物,但日常決策往往由本能和故事主導。

若真想依靠理性,就不能止於口號,而必須將其轉化為可執行的流程。以下為幾種常見方法:

- 為系統2設置"觸發條件"。面對高損失、不可逆或價值密集的決策,一律進入慢思考通道;明確書寫目標、備選方案、放棄條件和評估標準,用一頁紙列出證據與反證。

- 強制施行斯多葛式"負面想象"。進行預歿檢討(premortem),假設項目已失敗,反向推導可能的原因與防禦措施;設立獨立的"紅隊"負責唱反調,不受業務團隊影響。

- 先看基準率,再分析個案。藉助參考類預測,將"此類項目一般如何"作為錨點,再根據新證據調整,避免先講故事再湊數據。

- 量化不確定性並執行校準。關鍵判斷需附上概率和時間窗口,事後用Brier分數覆盤,將"我覺得"轉變為"我有60%的把握";持續記錄預測與結果,糾正一貫的樂觀或保守傾向。

- 記錄與複審。將核心假設、證據鏈、風險點和決策閾值寫成決策備忘錄;事後按同一模板覆盤,形成可學習的"錯誤資產"。

- 與機器協作而非對抗。將檢索、事實核對、重複性比對交給工具與模型,使人能聚焦於價值權衡與跨域聯想;團隊中設置"事實核對清單",所有關鍵數據須標註來源、時間戳和不確定區間。

- 建立組織層面的"剎車機制"。重大融資、併購或擴張前設置冷靜期;二次簽字須由不受結果直接影響的高管完成,以避免激勵錯配。

這套方法並不炫目,但切實有效:它承認人類天生衝動和易受敍事影響,同時提供了一條可操作的路徑,將"自以為理性"轉化為"可被檢驗的理性"。在此框架下,人並非要壓制本能,而是讓本能為理性所用;故事也並非被驅逐,而是受證據與邊界條件約束。這樣的人類理性才經得起現實的長期考驗。

兩種理性,誰更值得信賴?

大模型的理性是計算性的:快速、穩定、沒有情緒,能在短時間內整合碎片化信息並輸出邏輯一致的答案;其缺點也同樣明顯:在信息不全或超出訓練分佈的情況下,它會藉助語言流暢性進行"補位",導致產生缺乏依據的幻覺。

人類的理性則是生命性的:我們能同時權衡處境、價值與長遠後果,也具備自我懷疑的能力;弱點則在於速度、注意力和情緒,在壓力、激勵或宏大敍事的影響下,很容易偏離理性軌道。

再看二者"去幻"的方法。模型側通常採用在生成前後加入求證環節,如通過RAG確保答案有據可查,鏈式驗證將"先寫草稿、再逐項核對"自動化等。這類方法優勢在於可標準化、可規模化,但高度依賴外部知識庫與護欄設置,一旦撤除,幻覺易反彈。

人類側則更依賴流程與組織機制:如預歿檢討、設置獨立唱反調的紅隊、關鍵判斷附加"概率+時間窗口"並進行事後校準、重大決策引入冷靜期與二次簽字等。這些方法能將價值與情境納入約束,但執行成本較高,且容易受羣體動力與激勵錯配的影響而效果稀釋。

"誰更值得信賴"並沒有恆定答案,而是取決於問題類型。在數據完備、規則清晰、結果可驗證的場景中(如檢索、計算、編碼與合規審查),模型通常更可靠;而在價值密集、情境複雜、後果不可逆的決策中(如戰略選擇、倫理評估、創新方向),則應優先信任人類,由模型輔助提供證據與備選方案。沒有任何一方能在所有場景中"普遍勝出",真正的可信度源於將兩者系統化地融合。

混合理性,才是未來的燈塔

在AI時代,理性不再是一場獨角戲,而是人與機器共同完成的合奏。機器需藉助RAG、鏈式驗證、HSP等技術持續降低幻覺;人類則需通過反事實思考、批判性討論與跨界視角,克服認知偏差與敍事誤導。

真正可信的理性,源於融合機器計算精度與人類價值判斷的"混合理性"。它不僅是學術與商業進步的動力,更是未來社會穩健與創新的基石。機器可讓光芒更亮,但照亮何方,仍應由人決定。

引用

[1] Huang, L., Yu, W., Ma, W., Zhong, W., Feng, Z., Wang, H., ... & Liu, T. (2025). A survey on hallucination in large language models: Principles, taxonomy, challenges, and open questions. ACM Transactions on Information Systems, 43(2), 1-55.

[2] Bai, Z., Wang, P., Xiao, T., He, T., Han, Z., Zhang, Z., & Shou, M. Z. (2024). Hallucination of multimodal large language models: A survey. arXiv preprint arXiv:2404.18930.

[3] Zhang, W., & Zhang, J. (2025). Hallucination Mitigation for Retrieval-Augmented Large Language Models: A Review. Mathematics, 13(5), 856.

[4] Dhuliawala, S., Komeili, M., Xu, J., Raileanu, R., Li, X., Celikyilmaz, A., & Weston, J. (2023). Chain-of-verification reduces hallucination in large language models. arXiv preprint arXiv:2309.11495.

[5] Zhang, H., Chen, H., Chen, M., & Zhang, T. (2025). Active Layer-Contrastive Decoding Reduces Hallucination in Large Language Model Generation. arXiv preprint arXiv:2505.23657.

[6] Liu, Y., Yang, Q., Tang, J. et al. Reducing hallucinations of large language models via hierarchical semantic piece. Complex Intell. Syst. 11, 231 (2025).

[7] Farquhar, S., Kossen, J., Kuhn, L., & Gal, Y. (2024). Detecting hallucinations in large language models using semantic entropy. Nature, 630(8017), 625-630.

羅伯特·詹姆斯·席勒(Robert James Shiller, 1946年3月29日 - )耶魯大學經濟學教授、2013年諾貝爾經濟學獎得主,以行為金融學和資產定價研究聞名。他與人合編的Case-Shiller房價指數是全球房地產市場的重要風向標,他提出的席勒市盈率(CAPE)也常被用來判斷股市泡沫。他的代表作有《非理性繁榮》《動物精神》和《敍事經濟學》,強調故事和情緒在經濟中的作用。席勒性格温和卻常被視為"逆行者":在2000年互聯網泡沫和2008年金融危機前,他都因直言泡沫風險而被質疑,後來卻被證明準確。他的一句名言概括了其研究核心:"市場不是冷冰冰的貼現公式,價格圍着故事跳舞。"

💬 留言