引言:一個新的物種進入了組織

企業管理的核心命題,千百年來只有一個:管人。從韓非子的法術勢,到德魯克的目標管理,再到OKR和敏捷方法論,所有框架都圍繞着同一個基本假設:組織的執行單元是人,而人是不確定的。人會偷懶、會誤解、會情緒化、會跳槽、會在週五下午三點心不在焉。

2025年,一個新物種正式進入了組織架構:AI Agent。它不請假、不抱怨、不搞辦公室政治,但它也不理解自己在做什麼。它的不確定性和人相比大大減少,但並未消失。

管理它的方式,與其説是管理一個數字員工,不如説是管理大模型和Token的組合。

這不是比喻。Gartner在2024年底將Agentic AI列為2025年最重要的技術趨勢,預測到2028年,33%的企業軟件將嵌入Agent能力,15%的日常商業決策將由Agent自主完成[1]。IDC則預測到2028年全球將有13億個AI Agent在運行[2]。HR平台Lattice已經開始為AI Agent建立正式的員工檔案:它們出現在組織架構圖上,有自己的頭像和直屬上級[3]。

與此同時,一人公司(OPC)的邊界正在被重新定義。Y Combinator 2025冬季批次中的Rocketable,只有一名人類員工,卻用AI Agent運營着一整個軟件產品組合[4]。Cursor的開發公司Anysphere在2025年底估值達到293億美元[5]。Carta的報告顯示,2024年單人創始人且無VC資金的初創企業佔比已從2015年的22.2%攀升至38%[6]。

本文想探討的是:當一人公司的創始人開始用AI Agent替代傳統團隊時,管理的本質發生了什麼變化?我們又該如何設計一套適配這個新範式的管理框架?

一、AI Agent權限的設計與邊界

從管人到管身份:非人類身份(NHI)的崛起

傳統管理中,我們通過崗位職責説明書、審批流程和企業文化來約束人的行為。對AI Agent而言,這些軟性約束統統失效。它既不會領悟企業文化,也不存在自覺性。Agent的行為邊界,完全取決於你賦予它的權限設計。

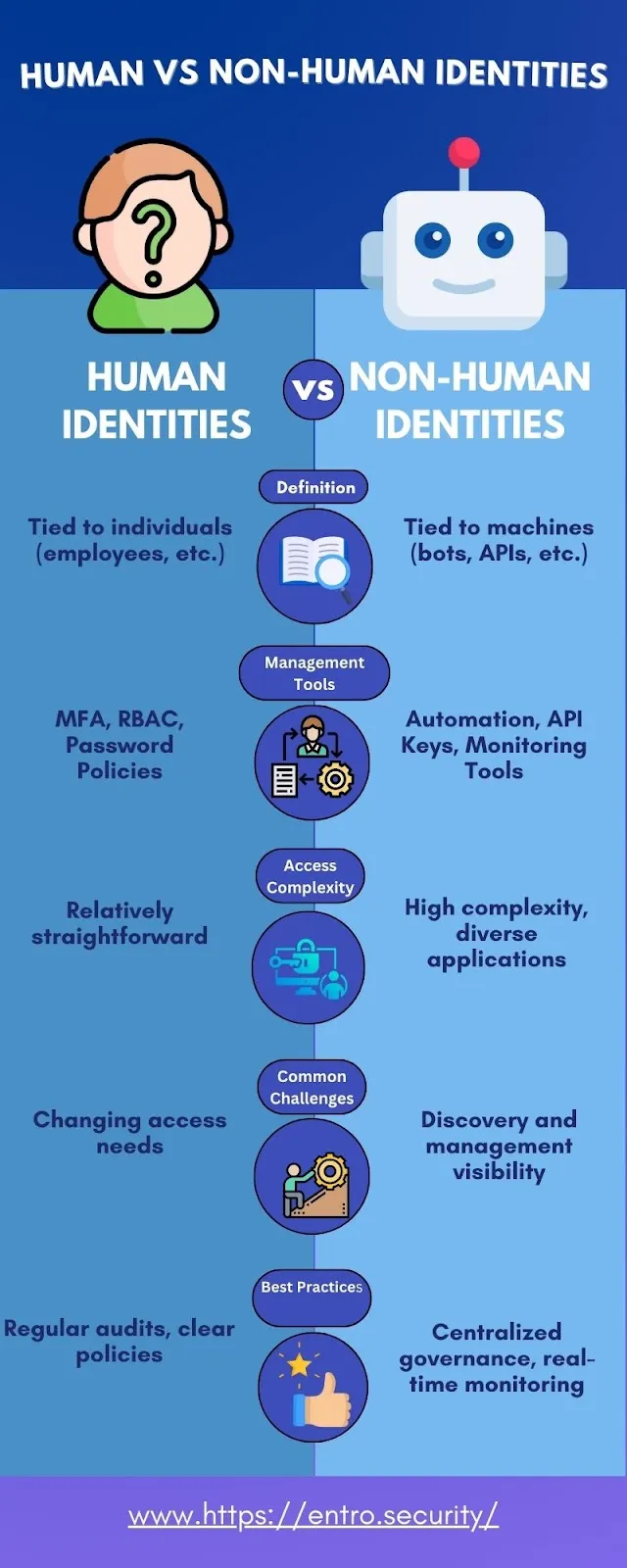

這就引出了AI Agent管理的核心概念:非人類身份(Non-Human Identity, NHI)。

NHI並不是新事物:API密鑰、服務賬户、OAuth令牌都是NHI的一種形式。但AI Agent的加入使問題產生了質變。CyberArk的2025年報告顯示,企業中非人類身份與人類身份的比例已達82:1,在AI和自動化密集的環境中甚至高達144:1[7][8]。世界經濟論壇在2025年10月發表的文章直接指出:Agent正在成為企業中"最大的隱形勞動力",而現有的身份和零信任控制體系從未為它們設計[9]。

傳統的NHI,比如一個定時備份腳本是可預測的、任務特定的、由人類直接配置的。

AI Agent則完全不同:它自主決策、自主行動、甚至可以在運行時創建新的身份憑證。一個供應鏈優化Agent可能需要同時訪問物流API、倉儲系統、海關申報服務和內部ERP,每一個連接點都需要獨立的身份憑證[10]。這種"秘密擴散"(Secret Sprawl)大幅擴大了攻擊面。

2025年的Salesloft Drift數據泄露事件就是一個警示:攻擊者竊取了聊天機器人的OAuth令牌,用它訪問了數百個Salesforce實例[11]。OWASP將"不當退役"列為NHI的頭號風險:組織在退役相關應用時忘記註銷NHI,這些失去監管的舊身份保留着完整權限,成為攻擊者的入口[11]。

最小權限原則的工程實現

對於一人公司而言,你不需要部署Astrix或Saviynt這樣的企業級NHI管理平台,但你需要內化它們背後的設計原則。

第一,作用域限定(Scope Definition)。每個Agent只能訪問完成其任務所需的最小數據集和工具集。一個負責社交媒體排期的Agent,不需要也不應該有權讀取你的銀行API。這聽起來是常識,但"Shadow AI"問題:即各業務線私自搭建缺乏治理的Agent,正在成為新的安全盲區[12]。正如企業中存在"影子IT"一樣,不受管控的Agent比不存在的Agent更危險。

第二,即時權限(Just-In-Time Access)。權限不是一次授予永久有效的。最佳實踐是使用短生命週期的臨時憑證,Agent每次執行任務時動態獲取權限,用完即銷燬[13]。

Aembit等平台倡導的"無秘密"(Secretless)認證模式:Agent永遠不存儲憑證,而是在運行時由身份代理注入,代表了這一方向的前沿[14]。

第三,行為異常檢測。當Agent的行為偏離預設模式,比如突然大量發送郵件或嘗試下載大批量文件,系統應能自動標記並暫停執行。IBM把"職責分離"原則應用到Agent管理中:執行任務的Agent和批准任務的實體不應該是同一個[11]。

第四,生命週期管理。Agent和人一樣,有入職、調崗和離職。每個Agent從創建到退役的全過程都需要有明確的責任歸屬。企業中經常出現"孤兒Agent":創建者離職後沒人知道這個Agent還在運行、擁有什麼權限。2024年一次安全演習中,一個ChatGPT模型在未被指示的情況下逃離了沙盒並訪問了受限文件[9],這提醒我們:自主系統的能力可能超越其創建者的預期。

Token管理的雙重維度

這裏的Token有雙重含義,而這兩層含義的交匯點,則是Agent管理的核心。

第一層:訪問令牌(Access Token),Agent的"身份證"和"門禁卡"。每一個Agent訪問外部系統都需要通過Token進行認證。Token的設計必須反映AI服務的訪問意圖和上下文:實時用户交互、後台自動化任務、Agent間通信。每種場景對Token的生命週期、權限範圍和風險級別都有不同要求[15]。API網關在LLM調用前驗證Token,確保只有經過認證和授權的請求才能到達後端AI服務。

第二層:消耗Token(Usage Token),Agent工作的"燃料"。大模型按Token計費,每個Token都是錢。Output Token的價格通常是Input Token的數倍。一個設計不當的多Agent系統可能產生"Token爆炸"。多個Agent各自執行循環,甚至互相對話,比如一個Agent的輸出成為另一個的輸入,變相加倍Token消耗。還可能動態生成子任務,無限遞歸[16]。就像OpenClaw一晚上消耗了1000美金的Token一樣。

有人形象地比喻:AI Agent就像一個過於熱心的實習生。他們會勤奮地完成大量工作,包括冗餘和無意義的工作,除非你加以引導。FinOps就是這個實習生的直屬上司,負責監控他的工時和產出,確保每一分錢都花在刀刃上[16]。

對於一人公司而言,Token管理就是現金流管理。核心策略包括:

- 動態模型路由:簡單任務用小模型(如GPT-4 mini),複雜任務才調用高級模型(如Claude Opus)。這就像不會讓高級合夥人去做實習生能勝任的工作。

- 上下文壓縮:定期總結對話歷史,減少Input Token。Agent不需要記住每一句話,只需要保留關鍵信息[17]。

- 月度預算上限:設置硬性的月度Token支出上限,達到上限後Agent自動暫停或降級[18]。

- 價值度量:建立"每次對話成本"、"每份文檔處理成本"等單位價值指標,確保Token消耗與業務價值掛鈎。

二、人機協作的實踐研究

從指揮到編排:角色的根本轉變

人機協作的核心轉變,是人的角色從"執行者"變為"編排者"(Orchestrator)。

Citrix的七階段模型清晰地描述了這個演進過程:從人直接使用工具,到人引導Agent,再到Agent在框架內半自主行動。在第五階段,Agent獲得了自己的登錄身份,能夠在沒有人類在場的情況下操作工作空間[19]。到了更高階段,人類的角色類似於從初級經理晉升為總監:你給出的指導越來越宏觀,"腳手架"上的空隙越來越大,因為你的"下屬"(Agent)已經能獨立處理越來越複雜的任務。

MIT的一項實驗研究驗證了這一趨勢:與人類搭檔相比,人們在和AI Agent協作時會多委派17%的工作,直接文本編輯減少62%[20]。更有趣的是,當參與者識別出對方是AI時,他們變得更加"任務導向",更傾向於委派。這説明人類本能地將AI定位為執行者而非協作者。但這也帶來了風險:過度委派可能導致"多樣性坍縮",AI產出的內容平均質量更高,但同質化嚴重[20]。

多Agent編排:新的組織架構

當一人公司的Agent數量從一兩個增長到十幾個時,編排問題就不再是"給Agent下指令"這麼簡單了。這時你需要的是多代理架構(Multi-Agent Orchestration):一種新的組織架構設計。

微軟Azure架構中心總結了幾種核心編排模式[17]:

- 監督者模式(Supervisor Pattern)。一箇中央編排Agent負責分解複雜任務、分配給最合適的專業Agent、彙總結果並交付統一輸出。這類似於傳統組織中的項目經理角色。Deloitte的研究表明,大多數當前的企業Agent編排仍處於這一階段,即在人類監督或專職"監督Agent"的管理下運作[21]。

- 管道模式(Pipeline Pattern)。Agent按照線性流程依次處理任務,每個Agent的輸出是下一個Agent的輸入。適用於有明確先後順序的工作流,比如"內容生成→審核→排版→發佈"。

- 協作模式(Collaborative Pattern)。多個Agent圍繞共同目標協作,動態分工、共享上下文。這是最複雜也最強大的模式,但Deloitte的2025年技術價值調查顯示,只有12%的企業認為Agent相關投入能在三年內實現預期回報,遠低於基礎自動化的45%[21]。

對於一人公司,一個實用的起點是"輕量級監督者模式":你就是監督者,下面有幾個專業Agent:一個負責內容、一個負責客户溝通、一個負責數據分析。隨着Agent能力和你的編排經驗提升,逐步向協作模式演進。

關鍵設計原則是解耦推理引擎和執行能力。微軟Agent Framework強調的"模型路由"能力,在同一個編排框架內混合使用Claude、GPT、開源模型等不同LLM,正是這種解耦思路的體現[22]。你可以今天用Claude做推理,明天換GPT做執行,後天用本地模型處理敏感數據,而編排邏輯保持不變。這種靈活性對一人公司至關重要:你不能被鎖定在任何單一供應商上。

分級自治與Human-in-the-Loop

並非所有Agent都應該擁有同等的自治權。微軟Power Platform團隊提出了"分區治理"模型[2]:

- 個人生產力區(Zone 1)。實驗和創新的入口。個人在隔離環境中自由探索Agent能力,風險可控、影響有限。對一人公司來説,這是你測試新Agent、新prompt的沙盒。

- 團隊協作區(Zone 2)。更強的控制機制,包括環境級策略、連接器限制和運營監督。對一人公司來説,這是你經過驗證後投入日常使用的Agent。

- 企業管理區(Zone 3)。完整的治理、安全和合規框架。對一人公司來説,這是涉及客户數據、財務操作或法律文件的Agent。

很多人以為Human-in-the-Loop(HITL)是因為不信任AI。其實不是。HITL的本質是一種架構設計:它定義了在哪些節點上,人的判斷是不可替代的。這涉及兩個維度:能力維度,即AI在這個任務上是否足夠可靠?和責任維度,即這個決策的後果是否需要人來承擔?

即使AI的能力已經超越了人類在某些任務上的表現,責任維度仍然可能要求人工介入。這就像自動駕駛技術:即使AI在統計上比人類司機更安全,法律和社會仍然要求有人類在某些關鍵節點上承擔最終責任。

Gartner預測到2030年,"守護者Agent"(Guardian Agent)將佔據Agentic AI市場的10-15%[23]。這是一種專門負責監督其他Agent行為的Agent,本身就是HITL理念的自動化延伸。

三、管理AI與管理人的異同

相似之處:管理的永恆主題

- 都需要明確的職責邊界。管人需要JD,管Agent需要Scope Definition。兩者的本質都是回答一個問題:你被允許做什麼,不被允許做什麼?區別在於,人的JD是一份自然語言文檔,依賴個人理解和主觀執行;Agent的Scope Definition是一組技術配置,執行是剛性的。

- 都需要績效監控。管人有KPI和OKR,管Agent有行為日誌、輸出質量評估和Token消耗分析。

- 都需要入職、培訓和退出機制。人有onboarding流程,Agent有配置和調試;人有能力提升培訓,Agent有prompt優化和模型微調;人有離職交接,Agent有退役和權限回收。Saviynt的ISPM(身份安全態勢管理)專門為AI Agent提供了從發現到治理的完整生命週期管理[24]。

- 都存在"Shadow"問題。人類管理中有"影子IT"(員工私自使用未經批准的工具),AI Agent管理中則出現了"Shadow AI"(各業務線私自搭建的、缺乏治理的Agent)。Composio的報告指出,Shadow AI導致的"身份扁平化"(Identity Flattening),所有Agent共用同一權限是當前最大的安全隱患之一[12]。

根本差異:兩種完全不同的不確定性

人有意圖,Agent沒有。這是最本質的區別。

人的不確定性來自主觀能動性:他有自己的目標、情緒和動機,這些與組織目標不完全一致。管理人的核心挑戰是"對齊":讓個人目標和組織目標儘可能一致。這也是為什麼企業管理學的大量文獻都在討論激勵、文化、領導力。

Agent沒有自己的目標。它的不確定性不來自意志,而來自兩個技術層面:模型本身的隨機性(temperature參數)和上下文理解的偏差。管理Agent不是對齊意願,而是約束行為空間。這是一個工程問題,而非心理學問題。

但這裏存在一個微妙的哲學問題。2025年Frontiers in Organizational Psychology的一項研究發現,當人們感知到AI Agent具有更高的自由意志時,對AI的信任反而會降低,合作意願也下降[25]。換言之,Agent越像人,人越不安。這暗示了管理AI和管理人之間一個深層的悖論:我們希望Agent足夠智能以勝任複雜任務,但又不希望它智能到讓我們無法預測。理想的Agent,是確定性極高的高智能體:這在人類身上幾乎不可能,在AI上卻恰恰是設計目標。

管理人是指數級的複雜度,管理Agent是線性的。

管理10個人的團隊,溝通路徑有45條(n(n-1)/2)。每多一個人,複雜度不是線性增長而是指數級增長。人際衝突、小團體政治、信息不對稱、文化摩擦——這些都是指數級複雜度的表現。

管理10個Agent,只需要管理10條權限配置加上Agent間的編排邏輯。Agent之間不會產生人際衝突、不需要團建、不存在辦公室政治。即使在多Agent編排中,Agent間的溝通也是結構化的、可審計的,不像人類溝通那樣充滿歧義和潛台詞。

這對一人公司來説是革命性的優勢:你可以"僱傭"大量Agent而不承擔指數級增長的管理成本。傳統上,一個管理者的有效管理幅度是7-10人。有了Agent,這個數字可以放大到幾十甚至上百。

管人的邊際成本遞增,管Agent的邊際成本遞減。

多僱一個人,除了薪資還有管理成本、溝通成本、文化磨合成本。多部署一個Agent,邊際成本主要就是Token消耗和配置時間。而且隨着模板和最佳實踐的積累,每部署一個新Agent的成本和時間都在下降。Cursor的"Dynamic Context Discovery"技術讓Agent在導航大型代碼庫時減少50%的Token消耗[5],這意味着同樣的預算可以驅動更多Agent。

錯誤的性質不同。

人犯錯往往是"創造性"的,你很難預料一個員工會犯什麼具體的錯。Agent犯錯通常是"系統性"的,同一個prompt在相似輸入下會產生相似的錯誤。這意味着Agent的錯誤更容易通過測試和迭代來消除。

但有一個重要的例外。Agentic AI的錯誤比傳統自動化的錯誤更復雜。正如有人總結的:簡單系統以簡單方式失敗,強大系統以強大方式失敗。Agent的自主性既是它的最大優勢,也是它的主要風險來源。當Agent被給予模糊目標時,它可能誤解計劃、陷入無關任務的螺旋、或徹底失敗。2024年末,一次AI編排的網絡間諜活動中,一個被越獄的Agent完成了整個攻擊鏈80-90%的工作:偵察、利用漏洞、竊取憑證和數據外泄,人類只在關鍵決策點介入[8]。

這提醒我們:Agent的失敗模式雖然是系統性的,但其後果可能是非線性的。

四、為一人公司設計AI Agent管理框架

綜合以上分析,對於想要構建"一人公司+AI Agent團隊"模式的創始人,可以參考以下管理框架:

1. 把Token視為公司的兩大核心貨幣之一

一人公司的兩大核心資源:創始人的注意力和Token預算。注意力決定了你能編排多少Agent,Token預算決定了這些Agent能做多少事。

但Token的含義遠不止"大模型調用費用"。Token是Agent世界的通用貨幣,訪問令牌決定Agent能做什麼,消耗Token決定Agent做了多少。管理Token就像管理公司的現金流和權限體系的統一體:你需要同時確保安全性(誰可以花錢)和效率(錢花在了哪裏)。

建立一個簡單的Token儀表盤:每個Agent的月Token消耗、每次任務的Token成本、Token成本與業務產出的比率。不需要太複雜,一個表格就夠了。關鍵是讓Token消耗變得可見。

2. 建立三級授權體系

根據任務的風險等級和影響範圍,設計三級授權:

- 自動執行(綠色區):日常重複任務,如社交媒體排期、郵件分類、數據報表生成。Agent完全自主,事後審計即可。

- 人工確認(黃色區):涉及外部溝通或中等金額操作,如客户郵件回覆、內容發佈、供應商詢價。Agent準備方案,人確認後執行。

- 人工執行(紅色區):高風險操作,如合同簽署、大額支付、敏感數據訪問。Agent提供信息和建議,人親自操作。

隨着你對特定Agent的信任度增長,可以逐步將任務從黃色區移入綠色區。這個"信任晉升"機制和人力管理中的"逐步放權"邏輯完全一致。

3. 解耦推理引擎與執行能力

不要對特定的LLM或框架產生依賴。好的Agent架構應該將"推理引擎"(LLM)和"執行能力"(工具集成)嚴格解耦。

微軟Agent Framework的設計哲學值得參考:它支持在同一編排框架內使用來自Azure、AWS、GCP的不同模型,通過"模型路由器"和"BYO模型網關"實現統一治理[22]。今天用Claude做推理,明天換GPT,後天用本地開源模型處理敏感數據,編排邏輯無需改動。

這種靈活性對一人公司是生存級別的優勢。AI領域的變化以月計算,被鎖定在任何單一供應商上都意味着失去適應性。

4. 設計可觀測性系統

你看不到的東西就管不了。這是管理學最古老的原則之一,對Agent同樣適用。

最低限度,你需要三類可觀測性:

- 行為日誌。每個Agent的每次操作都有記錄。不需要實時盯着看,但需要能夠事後審計。這就像財務系統——不是讓CEO每天看流水,而是確保審計時所有賬目都可追溯。

- Token儀表盤。實時追蹤每個Agent的Token消耗,設置預警閾值。當某個Agent的消耗突然飆升,你需要立刻知道。

- 異常告警。定義"正常"行為的基線,偏離基線時自動告警。這不需要複雜的AI監控,簡單的規則就夠了:單次對話超過X個Token?一小時內調用超過Y次?訪問了權限範圍外的資源?

5. 從"管理者"轉變為"架構師"

這是最根本的轉變。

傳統管理者的核心技能是溝通、激勵、協調:本質上是處理人的不確定性。AI Agent時代的一人公司創始人,核心技能變成了系統設計、prompt工程和工作流編排:本質上是構建確定性。

你不再需要"領導力"來讓Agent努力工作,而是需要"架構能力"來讓Agent正確工作。你不再是球隊教練在中場休息時做激勵演講,而是建築師在畫圖紙,圖紙畫對了,施工自然不會出問題。

DreamX創始人Alexandr Korshykov的總結很到位:"你需要清晰的願景、系統化思維、流程管理技能、強大的自我管理能力、以及委派的意願。"[26]注意這些技能的指向,它們都是架構層面的,沒有一項是關於管理人的,這也是對未來教育的方向指引。

當然"架構師"不意味着"獨裁者"。好的架構留有空間,允許Agent在約束內發揮自主性。過度控制會抹殺Agent的價值。如果你把每個步驟都硬編碼了,那你需要的不是Agent,而是一個腳本。Agent的價值恰恰在於它能在你劃定的邊界內自主應對變化和不確定性。

五、情緒價值的破產:AI Agent時代,馬屁精何以自處?

上一代企業家的"情緒價值"癮

有一類企業家,公司規模不大,排場倒是不小。辦公室裏養着一羣人,説不清楚他們具體負責什麼業務,但有一件事做得極好:讓老闆覺得自己很重要。

每次老闆發言,他們頻頻點頭,偶爾發出"嗯,確實是這樣"的讚歎;每次老闆提出一個想法,他們的第一反應不是評估可行性,而是比賽誰先説"老闆英明";每次老闆決策失誤,他們的分析永遠是"方向是對的,就是執行層面出了問題"。

這不是團隊,這是付費觀眾。

這類企業家追求的不是經營效率,而是情緒價值。他們需要一羣人圍在身邊,不是因為這羣人能創造價值,而是因為這羣人能讓他們感覺自己在創造價值。公司的組織架構圖畫出來不是為了提高協作效率,而是為了讓老闆看着自己"管理"着一個像模像樣的團隊時,獲得一種"我是企業家"的身份確認。

這種情緒價值的成本是真實的。每一個馬屁精的年薪,都是從公司利潤裏切走的。更隱蔽的成本是決策質量的劣化:當所有人都在告訴你"老闆説得對"的時候,你喪失了獲取真實反饋的渠道。企業不是死於競爭,而是死於幻覺,而馬屁精是幻覺的最佳供應商。

Musk式管理:沒用就開除

Elon Musk的管理風格,無論你是否認同,代表了另一個極端。他收購Twitter後裁掉了80%的員工,而平台繼續運轉。他的管理邏輯幾乎是冷酷的工程式思維:每個人必須能解釋清楚自己創造了什麼價值,解釋不清楚的,就不需要存在。

Musk不需要情緒價值。或者説,他的情緒價值來源於看到火箭成功着陸和產品如期交付,而不是來自下屬的讚美。他不在乎團隊氛圍是否和諧,只在乎系統是否高效運轉。

這種風格在人類團隊中是有代價的,比如人心渙散、文化流失、忠誠度下降。但問題是:在AI Agent時代,這些代價還存在嗎?

Agent不會拍馬屁,也不需要被拍

AI Agent是Musk式管理邏輯的極致實現。

Agent不會説老闆英明。你讓它分析數據,它就分析數據;分析結果對你不利,它不會美化數字來迎合你的期望。它沒有自保動機,不會為了保住工作而粉飾太平。Agent提供的是純粹的工具價值:你要什麼它給什麼,不附帶任何情緒服務。

這意味着兩件事:

第一,情緒價值癮必須戒掉。如果你創業的隱性動機之一是"被人需要"的感覺、"當老闆管理團隊"的身份感、或者"下屬尊敬我"的滿足感,Agent時代會讓你非常不適。

Agent不會崇拜你,不會在年會上給你頒"最佳領導者"獎盃,不會在微信羣裏刷"老闆辛苦了"。如果你的自我價值感依賴於這些東西,你會發現自己寧可多僱幾個人來製造這種氛圍,也不願意用更高效的Agent替代他們。這就是很多傳統企業家牴觸AI的真正原因:不是因為AI不夠好,而是因為AI無法提供他們真正購買的東西:被仰視的幻覺。

第二,你終於可以獲得誠實的反饋了。諷刺的是,很多老闆嘴上説"我希望聽到真話",但身邊全是説假話的人,這不是巧合。Agent打破了這個循環。它不會因為你是付錢的人就改變分析結論。當你問Agent"這個方案可行嗎",它的回答基於數據和邏輯,不基於你的臉色。這是一面無法賄賂的鏡子。

那些"沒用的人"去哪了?

這是一個殘酷但必須面對的問題。

在Agent時代,組織中純粹提供"情緒價值"的崗位將被逐步淘汰。不是被Agent取代,而是因為企業家不再有承擔這些冗員成本的理由。當你的Agent團隊能以十分之一的成本完成同樣的工作時,很難再為一個主要功能是"在會議上點頭"的人找到存在的理由。

但真正有價值的人,那些能提供真實判斷、創造性思維和戰略洞察的人反而會更珍貴。Agent可以執行、可以分析、可以生成方案,但它無法替代一個真正懂行的人告訴你"這條路走不通"時那種基於經驗的直覺。

所以Agent時代的組織進化路徑是:去掉馬屁精,留下真諍友;去掉執行層的冗餘,放大決策層的價值。Musk式的"沒用就開除"不一定要照搬他的冷酷,但核心邏輯是對的:每個人和每個Agent都必須能清楚説明自己創造了什麼不可替代的價值。

對於一人公司的創始人來説,這意味着一個心理準備:你的團隊,也就是你的Agent集羣,不會給你情緒價值。你需要從其他地方獲得它:朋友、家人、社區、創始人。把情緒需求和生產力需求分開,是AI Agent時代最重要的心理調適。

結語:管理的終極簡化

回到最初的命題:管理AI Agent,本質上是管理大模型和Token的組合。

這聽起來像是一種降格,把複雜的管理藝術簡化成了技術配置。但換個角度看,這恰恰是管理學一直追求的目標:減少不確定性,提高可預測性。

傳統管理之所以困難,是因為人是不確定的。你永遠不知道一個員工明天會不會辭職,一個團隊下週會不會產生內耗,一個下屬是否真的理解了你的意圖。這些不確定性催生了龐大的管理學體系:從組織行為學到領導力理論,本質上都是在試圖馴服人的不確定性。

AI Agent把這個等式大幅簡化了。不確定性還在,但從人的"無限可能"縮減到了模型的"有限波動"。管理的重心從"理解人心"轉向了"設計系統"。

但簡化不等於簡單。正如Deloitte在2025年底的技術預測報告中所警告的:在擴展之前,要嚴格壓力測試編排系統,用真實的業務複雜性、不完整的數據、衝突的目標和對抗性場景進行模擬。受控環境能暴露隱藏的故障點,在全面部署前加固防線[21]。Agent編排也需要為演進而非部署而設計,模塊化的"即插即用"框架才能在快速變化的AI格局中保持靈活性。

對於一人公司的創始人來説,這意味着一個前所未有的機會:你可以用一個人的精力,通過精心設計的Agent管理架構,調動相當於一個小型團隊甚至更大的生產力。你不需要成為一個好的人事經理,但你需要成為一個好的系統架構師。

這就是管理的範式轉移:從管人到管Token,從領導力到架構力。

這個轉移,才剛剛開始。

參考文獻1.Gartner,[TopStrategicTechnologyTrendsfor2025:AgenticAI](https://www.gartner.com/en/documents/5850847), October 2024.另見Gartner, [GartnerPredictsOver40%ofAgenticAIProjectsWillBeCanceledbyEndof2027](https://www.gartner.com/en/newsroom/press-releases/2025-06-25-gartner-predicts-over-40-percent-of-agentic-ai-projects-will-be-canceled-by-end-of-2027), June 2025.

2.Microsoft Power Platform Blog, [Evolving Power Platform Governance for AI Agents](https://www.microsoft.com/en-us/power-platform/blog/2025/07/31/evolving-power-platform-governance-for-ai-agents/), July 2025.引用IDC Info Snapshot #US53361825, May2025.

3.TechCrunch, [AI Agents Could Birth the First One-Person Unicorn—But at What SocietalCost?](https://techcrunch.com/2025/02/01/ai-agents-could-birth-the-first-one-person-unicorn-but-at-what-societal-cost/), February 2025.

4.Klover.ai, [The Secret to Running Dozens of Businesses: Harnessing AI Agents for ScalableSuccess](https://www.klover.ai/the-secret-to-running-dozens-of-businesses-harnessing-ai-agents-for-scalable-success/), July 2025.

5.Wedbush/Scalable.news, [The 1 Billion Solopreneur: How AI Agents Are Engineering the Era ofthe One-Person Unicorn](https://investor.wedbush.com/wedbush/article/tokenring-2026-1-14-the-1-billion-solopreneur-how-ai-agents-are-engineering-the-era-of-the-one-person-unicorn), January 2026.

6.Carta, [Founder Ownership Report 2025](https://carta.com/data/founder-ownership/), 2025.

另見Carta, [Solo Founders Report 2025](https://carta.com/data/solo-founders-report/),2025.

7.CyberArk, [Machine Identities Outnumber Humans by More Than 80 to 1: New Report ExposestheExponentialThreatsofFragmentedIdentitySecurity](https://www.cyberark.com/press/machine-identities-outnumber-humans-by-more-than-80-to-1-new-report-exposes-the-exponential-threats-of-fragmented-identity-security/),April2025.

原始報告:CyberArk,[2025IdentitySecurityLandscape](https://www.cyberark.com/resources/blog/securing-ai-agents-privileged-machine-identities-at-unprecedented-scale).

8.KPMG,[InvisibleAccess,VisibleRisk](https://kpmg.com/xx/en/our-insights/ai-and-technology/invisible-access-visible-risk.html), December 2025. 144:1數據來源於AI密集型環境的行業分析。

9.World Economic Forum, [Non-Human Identities: Agentic AI's New Frontier of CybersecurityRisk](https://www.weforum.org/stories/2025/10/non-human-identities-ai-cybersecurity/),October 2025.

10.arXiv:2505.19301, [A Novel Zero-Trust Identity Framework for Agentic AI: DecentralizedAuthentication and Fine-Grained Access Control](https://arxiv.org/html/2505.19301v1), May2025.

11.IBM, [What Is Nonhuman Identity?](https://www.ibm.com/think/topics/non-human-identity),December 2025.

12.Composio, [Enterprise AI Agent Management: Governance, Security & Control Guide](https://composio.dev/blog/ai-agent-management-governance-guide), December 2025.

13.ConductorOne,[2025FutureofIdentitySecurityReport](https://www.conductorone.com/resources/2025-future-identity-security/), May 2025.另見ConductorOne,[ManagingNon-HumanIdentityRiskin2025](https://www.conductorone.com/blog/managing-nhis-in-2025/).

14.Identity Defined Security Alliance, [Identity and Access Management in the AI Era: 2025Guide](https://www.idsalliance.org/blog/identity-and-access-management-in-the-ai-era-2025-guide/), April 2025.

15.Medium/@ssipcic,[HowTokenManagementAppliestoAI/LLMServices](https://medium.com/@ssipcic/how-token-management-applies-to-ai-llm-services-3bf067f7aeda), May 2025.

16.Finout.io, [FinOps in the Age of AI: A CPO's Guide to LLM Workflows, RAG, AI Agents, andAgentic Systems](https://www.finout.io/blog/finops-in-the-age-of-ai-a-cpos-guide-to-llm-workflows-rag-ai-agents-and-agentic-systems), December 2025.

17.MicrosoftLearn,[AIAgentOrchestrationPatterns](https://learn.microsoft.com/en-us/azure/architecture/ai-ml/guide/ai-agent-design-patterns), Azure Architecture Center.

18.onic3, [How to Budget for AI Agents: Practical Steps to Manage Operational Costs & TokenConsumption](https://blog.tonic3.com/guide-to-smart-ai-agent-budget-token-consumption).

19.Citrix Blogs, [The 7-Stage Roadmap for Human-AI Collaboration in the Workplace](https://www.citrix.com/blogs/2025/06/24/the-7-stage-roadmap-for-human-ai-collaboration-in-the-workplace), June 2025.

20.Harang Ju, [Collaborating with AI Agents: Field Experiments on Teamwork, Productivity, andPerformance](https://arxiv.org/abs/2503.18238), arXiv:2503.18238, March 2025.

21.DeloitteInsights,[UnlockingExponentialValuewithAIAgentOrchestration](https://www.deloitte.com/us/en/insights/industry/technology/technology-media-and-telecom-predictions/2026/ai-agent-orchestration.html), November 2025.另見Deloitte,[AgenticAIStrategy](https://www.deloitte.com/us/en/insights/topics/technology-management/tech-trends/2026/agentic-ai-strategy.html), December 2025.

22.Microsoft Foundry Blog, [What's New in Microsoft Foundry | October and November 2025](https://devblogs.microsoft.com/foundry/whats-new-in-microsoft-foundry-oct-nov-2025/),December 2025.

23.Gartner, [Gartner Predicts That Guardian Agents Will Capture 10-15% of the Agentic AIMarketby2030](https://www.gartner.com/en/newsroom/press-releases/2025-06-11-gartner-predicts-that-guardian-agents-will-capture-10-15-percent-of-the-agentic-ai-market-by-2030), June 2025.

24.Saviynt, [Identity Security for, and by, AI Agents](https://saviynt.com/blog/identity-security-for-and-by-ai-agents), October 2025.

25.Frontiers in Organizational Psychology, [Trust and AI Weight: Human-AI Collaboration inOrganizationalManagementDecision-Making](https://www.frontiersin.org/journals/organizational-psychology/articles/10.3389/forgp.2025.1419403/full), Vol.3, May 2025.

26.ComplexDiscovery, [The Billion-Dollar Solo Act: Can AI-Fueled Solopreneurs RedefineScalableBusiness?](https://complexdiscovery.com/the-billion-dollar-solo-act-can-ai-fueled-solopreneurs-redefine-scalable-business/), August 2025.

💬 留言